DreamFusion - 每日一读[7.15]

论文链接:

http://arxiv.org/abs/2209.14988

发布时间:2022.9.29

一、研究方向:

Zero-shot 的 text-to-3D合成 的经典之作

二、研究动机:

- lift pretrained 2D generations to 3Ds. (当时还没有很好的方法来把预训练的2D生成模型用到3D生成任务上,再考虑到那时候diffusion和nerf都很火,dreamfusion成功地把它们结合起来了,效果在当时很优秀)

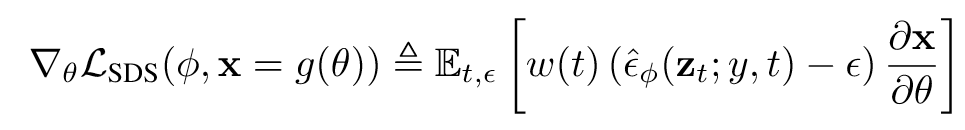

- 对标CLIP Loss,提出了SDS Loss(在一年后的今天,又出现了很多改进版的loss,例如之前讲的DDS,VSD,CSD)

三、方法与技术:

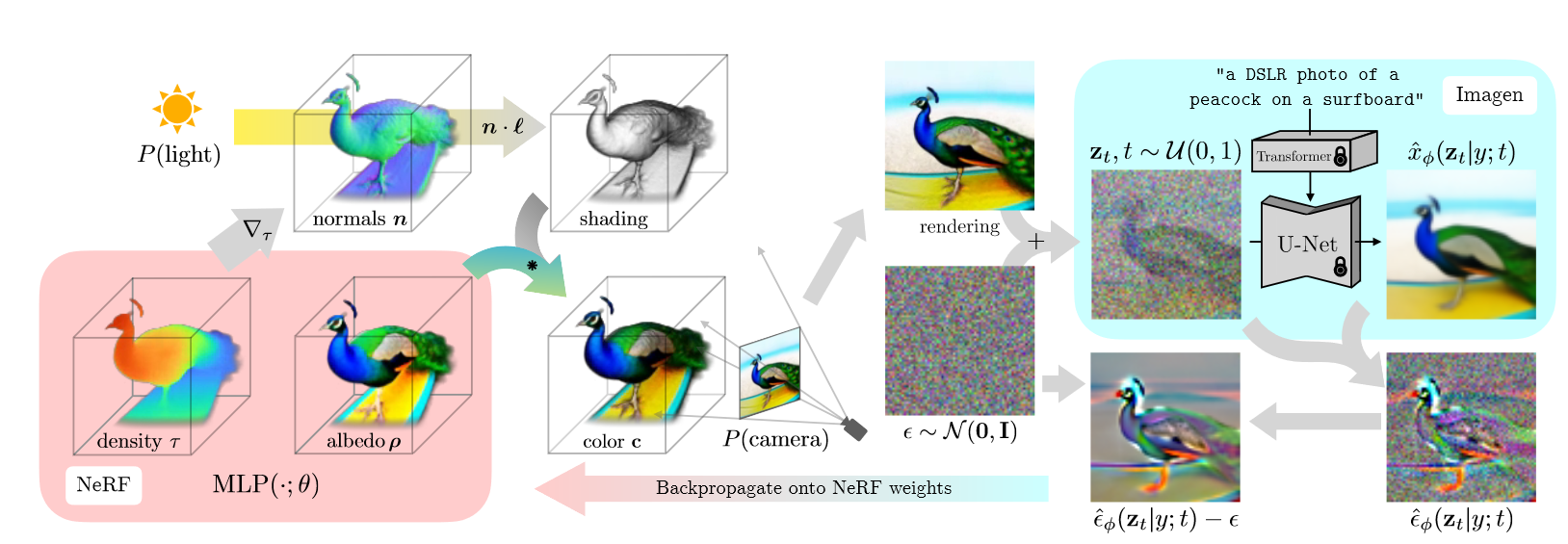

没什么好说的,就是把2D Diffusion固定住,然后重建目标是一个nerf的一个视角渲染,recon loss的梯度传回3D场而不是用于训练2D模型,这样就把2D pretrained模型的信息蒸馏到了3D场里。

显而易见的pipeline:

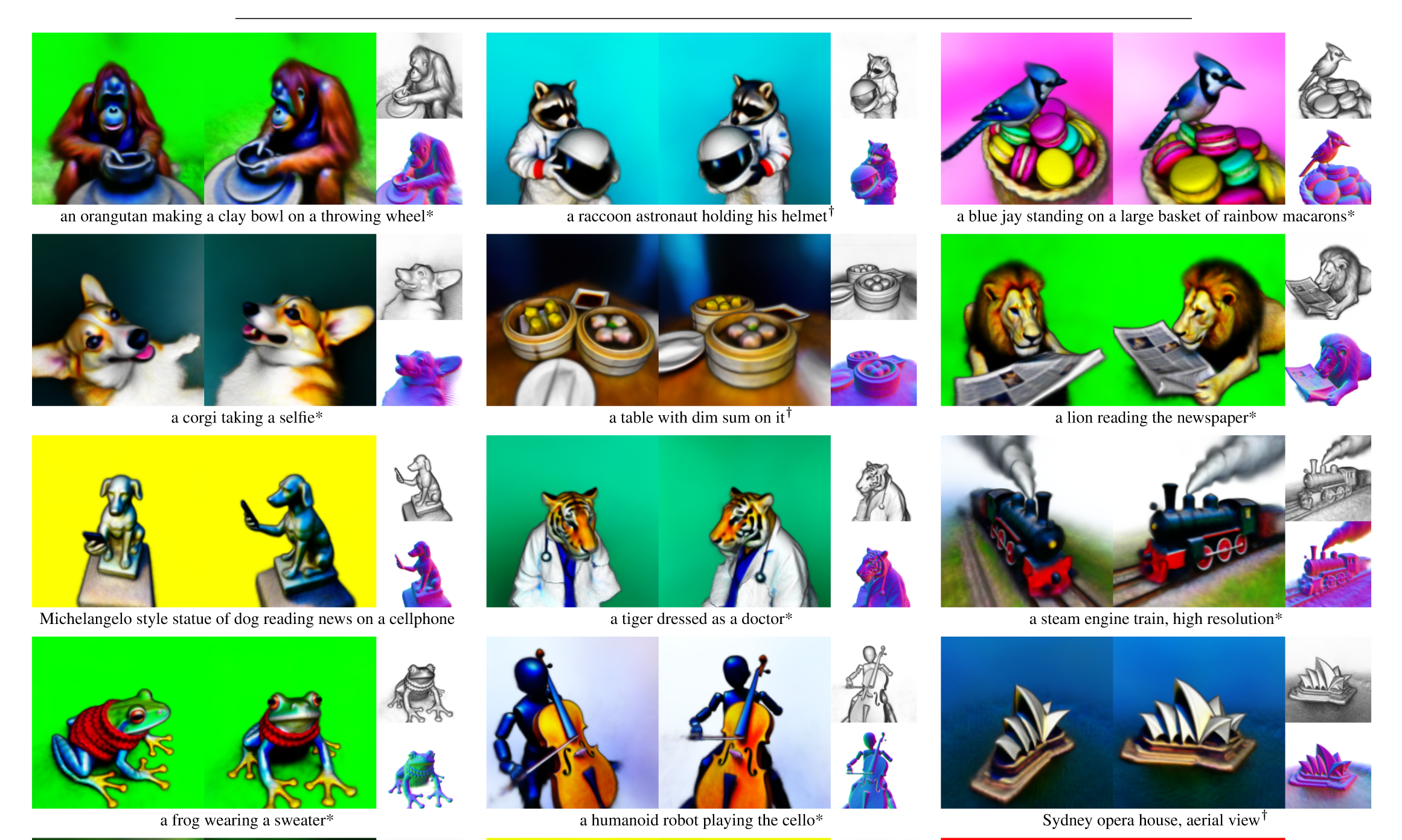

四、实验结果:

不重要,已经过去一年了。

五、主要贡献:

SDS Loss

评价:

- SDS是过去一年几乎所有基于pretrained diffusion的3D generation任务的基石

- 效果在如今已经算是一般般了,没必要看

- 预计下半年会出现越来越多替代SDS的新型loss

推荐相关阅读:

- Collaborative Score Distillation for Consistent Visual Synthesis

- ProlificDreamer: High-Fidelity and Diverse Text-to-3D Generation with Variational Score Distillation

- Delta Denoising Score

All articles in this blog are licensed under CC BY-NC-SA 4.0 unless stating additionally.